当你的第一个 AI 应用从一个 Demo 变为生产可用的服务时,你很快会意识到,最困难的部分是将其与世界连接的基础设施。为过去十年的网络流量构建的基础设施,无法应对大型语言模型(LLM)的独特需求。

这篇博客将讲述我们,Apache APISIX 项目背后的团队,为何决定从零开始构建一款全新的 AI 网关。这,就是 AISIX 的故事。

一种新的流量需要一种新的网关

生成式 AI 的崛起引发了 API 流量的剧变。定义了上一个时代的可预测、无状态的请求-响应模式,正在被一种全新的、要求更高的模式所取代。这不仅仅是一个趋势,而是一场席卷整个市场的变革。据 Menlo Ventures 在 2025 年末的文章显示,企业在生成式 AI 上的支出在 2025 年达到 370 亿美元,是 2024 年 115 亿美元的三倍多。伴随着这种爆炸性增长,我们正面临一系列无法通过简单修补旧系统来解决的新基础设施挑战。

| 挑战 | 描述 |

|---|---|

| 不可预测的成本 | 基于 Token 的计价方式使 LLM 的成本如同一个“黑箱”。一次微小的代码变更可能导致成本增加十倍,若无精确到 Token 级别的追踪,预算将形同虚设。 |

| 可观测性的盲区 | 传统网关只能度量请求数和总延迟,但无法追踪 Token 用量、TTFT(首 Token 延迟)、单次请求成本等 LLM 特有指标。没有这些数据,优化和排障无从谈起。 |

| 安全与治理的困局 | 如何管理数十种不同模型的凭证?如何防止提示注入攻击?如何确保敏感的个人身份信息(PII)数据不会泄露给第三方模型?旧有的安全范式已然捉襟见肘。 |

| 模型路由的复杂性 | 企业同时使用多个 LLM 提供商,每个模型有不同的 API 格式、速率限制和定价。传统网关缺乏按模型能力、延迟或配额进行智能路由和自动 Fallback 的能力。 |

我们注意到有厂商试图通过为其现有 API 网关增加越来越多的插件来解决这些问题,但这不过是权宜之计。一个为无状态微服务流量设计的 API 网关,无法优雅地改造以管理 AI 工作负载的流式和计算密集型特性。

LLM 和 AI Agent 应该是一等公民,而非插件

作为 Apache APISIX 项目的发起者,过去七年我们致力于构建一款高性能、高可靠的开源 API 网关。我们将其发展成为 Apache 顶级项目,受到全球来自各行业企业的信赖,处理其最关键的流量。这段旅程让我们站在了 API 基础设施演进的前沿。

当 AI 浪潮来袭时,我们是首批响应者之一,为 APISIX 构建了 AI 插件,例如 ai-proxy 和 ai-prompt-guard,以帮助我们的用户适应。但我们构建得越多,就越意识到我们正在触及底层架构的极限。我们看到用户将多个插件连接在一起以实现基本的 AI 特定功能,但导致了复杂、脆弱的配置和糟糕的用户体验。

这次经历让我们深刻反思:过去我们习惯于从数据面技术开始思考,但对于 AI Gateway 这样新兴的事物,产品定位、概念抽象和用户体验应当排在首要考虑的位置。 用户关心的不是我们用了什么技术,而是最终产品是否好用、是否能真正解决他们的问题。

我们意识到,世界所需要的不是另一套 AI 插件,而是一个原生的 AI 网关,一个从零开始、为应对 AI 的独特挑战而设计的网关。这一观察得到了市场预测的验证:Gartner 预测,到 2028 年,70% 构建多模态应用的软件工程团队将使用 AI 网关来提高可靠性和优化成本。

我们做出了一个自然的决定。我们没有继续在 API 网关的基础之上进行构建,而是决定做一个 AI 原生的产品。我们吸取了构建 APISIX 的所有经验,并启动了一个专为 AI 时代而生的项目,我们称之为 AISIX。

我们相信,AI Gateway 的终极价值在于服务下一代 AI Agent。当 Agent 开始自主调用工具、与其他 Agent 协作时,它们需要一个可靠、安全、高性能的基础设施层。AISIX 的原生架构正是为这个未来而设计的。在我们的第一个版本中,我们先解决最紧迫的 LLM 管理挑战;在后续版本中,我们将逐步引入对 Agent 编排和 MCP 等协议的支持。

原生 AI 网关

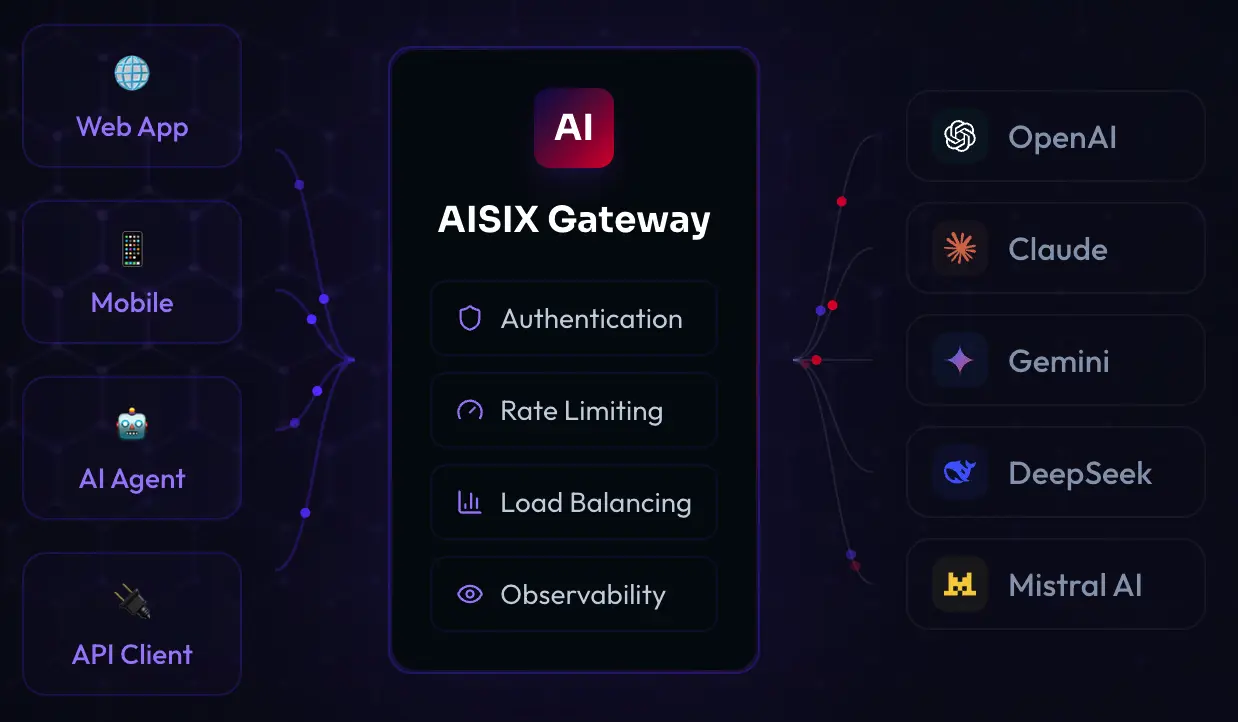

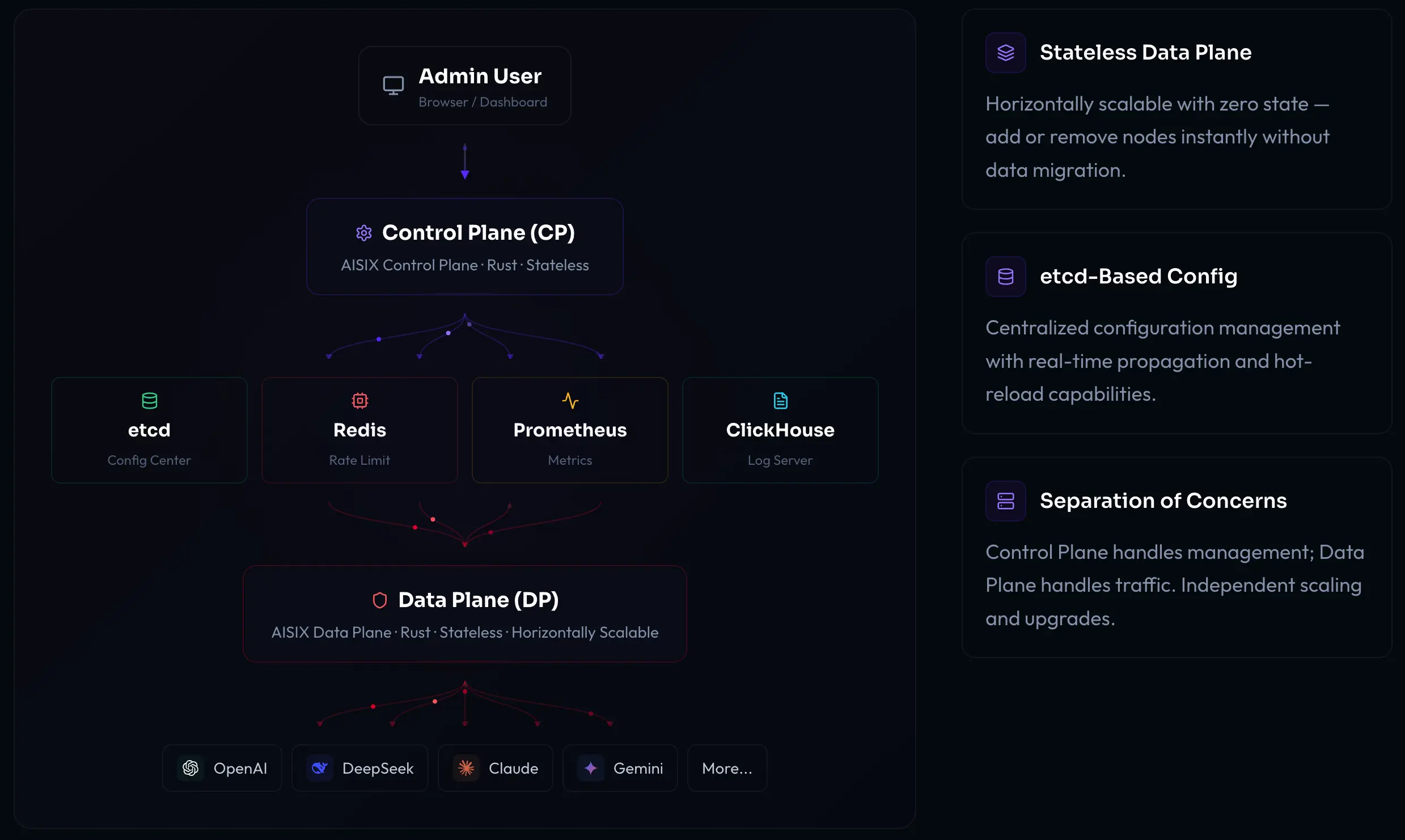

AISIX 是我们对 AI 时代挑战的回应。它是一款精简、强大且对开发者友好的 AI 网关,提供了一套强大的功能,所有功能都是为支持 AI 工作负载而原生设计的。

AISIX 首版本已实现功能:

| 功能 | 价值主张 |

|---|---|

| 统一的 LLM 访问 | 通过单一、一致的 API 访问来自 OpenAI、Azure、Anthropic、Google Gemini 等的模型。包含智能路由和负载均衡。 |

| 企业级可观测性 | 获取精确到 Token 级别的成本分析、延迟监控和详细日志,以理解和控制您的 AI 支出。 |

| 精细的流量控制 | 支持基于 Token 和请求数的速率限制(TPM/TPD, RPM/RPD),可精确到单个虚拟密钥或模型。 |

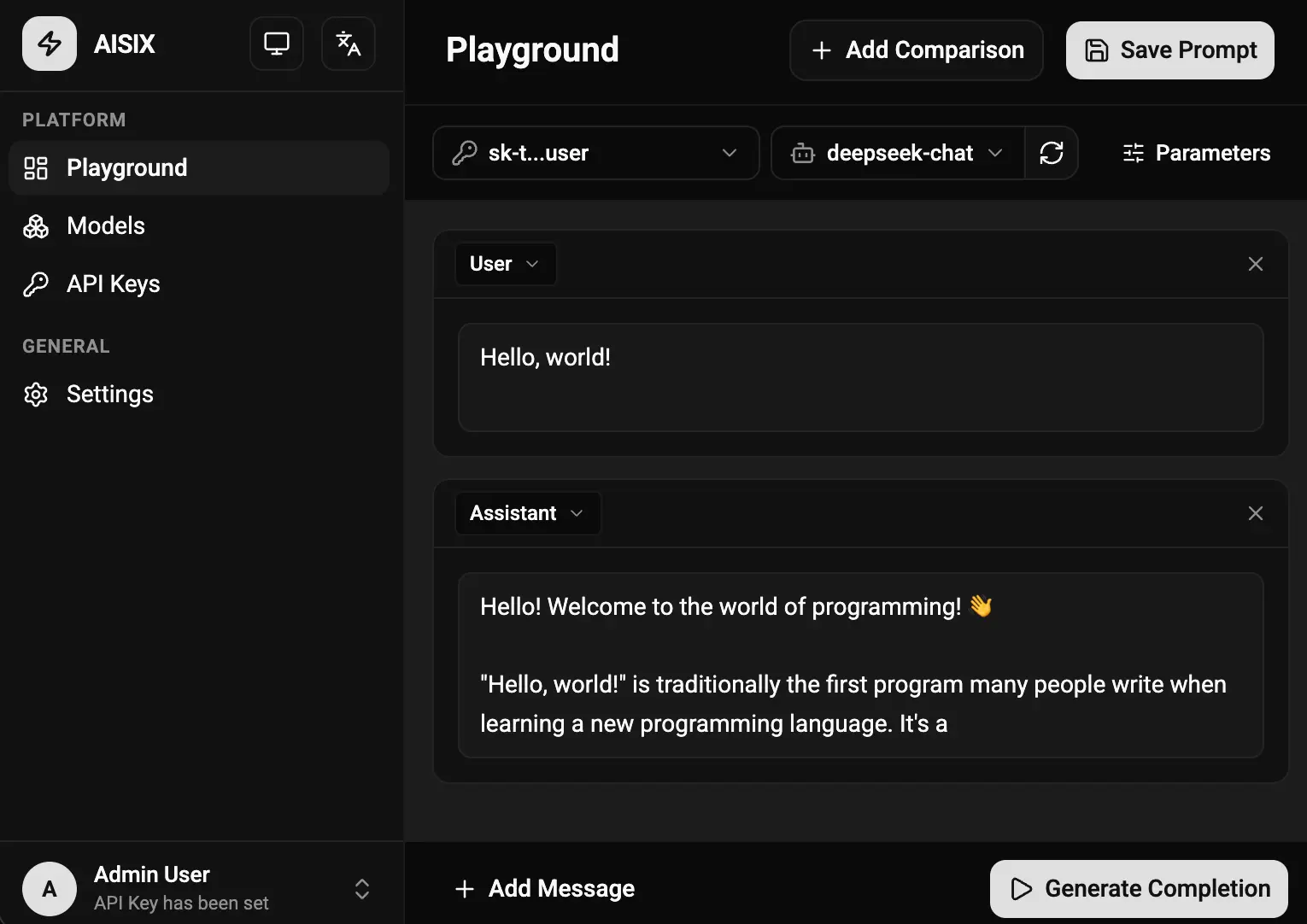

| 开发者友好的工具 | 简洁的 Admin UI 和交互式 Playground,让开发者可以快速测试和调试他们的 AI 应用。 |

| 面向未来的架构 | 原生支持流式响应,并为未来的 AI Agent 和 MCP(模型上下文协议)等新协议提供一流的支持。 |

因为 AISIX 是一个原生的 AI 网关,这些功能并非“附加”的;它们被集成到产品的核心中,从而形成一个比任何改造方案都更简单、性能更高、更安全的系统。

在开放中构建更好的 AI 基础设施

我们相信,最伟大的基础设施软件总是通过充满热情的社区的集体努力、在开放中构建的。AISIX 的故事才刚刚开始,我们希望你也能成为其中的一部分。无论你是正在构建第一个 AI 应用的开发者,还是正在设计企业级 AI 战略的架构师,在 AISIX 社区中都有你的一席之地。

- 在 GitHub 上给我们点亮 Star:你的认可是我们最大的动力。请访问 github.com/api7/aisix 并给我们一个 Star。

- 加入对话:有任何问题或想法?加入我们的 社区 Discord 频道,与核心开发者直接交流。

- 成为贡献者:我们会为你准备一份 Good First Issues 列表。我们期待看到你的第一个 PR。

- 五分钟快速上手:通过 api7.ai/ai-gateway 了解产品详情,并参照 官方文档 启动你的第一个 AISIX 实例。

让我们一起为下一个十年的 AI 应用构建基石,携手共进。